Visitar un lugar desconocido supone un gran esfuerzo y una situación estresante para las personas invidentes. Incluso lugares conocidos pueden resultar problemáticos si los muebles cambian de sitio o si, simplemente, el cansancio empeora momentáneamente la atención y la memoria.

La carencia de información visual impone una fuerte carga cognitiva a la hora de familiarizarse con la disposición de los obstáculos. Es necesario recordar todo el tiempo el lugar del espacio que se ocupa para poder planificar cómo llegar a donde se desea ir.

Los desplazamientos causan elevados niveles de incertidumbre e inseguridad. Las estructuras sobresalientes a la altura de la cabeza, como letreros, y algunas concavidades del entorno provocan situaciones de riesgo. Aunque el bastón clásico es muy útil para ayudar a las personas invidentes, no basta con esta herramienta para abordar todos los retos que afrontan.

La solución complementaria tradicional consiste en hacer una visita previa a los lugares con la ayuda de mapas táctiles. Otras variantes más sofisticadas y flexibles incluyen los sistemas computarizados o de realidad virtual, que permiten la visita desde la comodidad del hogar.

No obstante, estas herramientas siguen suponiendo un esfuerzo, ya que exigen recordar el sitio y no son fáciles de consultar en tiempo real mientras se está visitando físicamente el lugar.

La tiflotecnología engloba las herramientas para ayudar a personas con ceguera o discapacidad visual a utilizar la tecnología. Uno de sus principales retos es proporcionar información distante, es decir, aquella que está más allá del alcance de la mano o del bastón.

En el Centro de Tecnología Biomédica (CTB) de la Universidad Politécnica de Madrid, un equipo de investigadores pertenecientes al Grupo de Investigación en Tecnologías de Apoyo a la Vida (LST), al Centro de Investigación Biomédica en Red (CIBER-BBN) y a la Universidad de las Fuerzas Armadas de Ecuador trabajamos desde años en el proyecto eGLANCE.

En nuestras investigaciones utilizamos conceptos de la realidad virtual y la realidad aumentada para facilitar más información a las personas invidentes sobre su entorno.

Uno de los resultados más relevantes de eGLANCE hasta la fecha es un modelo de interacción para realidad virtual adaptado a las necesidades de los ciegos o, lo que es lo mismo, una herramienta de realidad virtual tiflointeractiva.

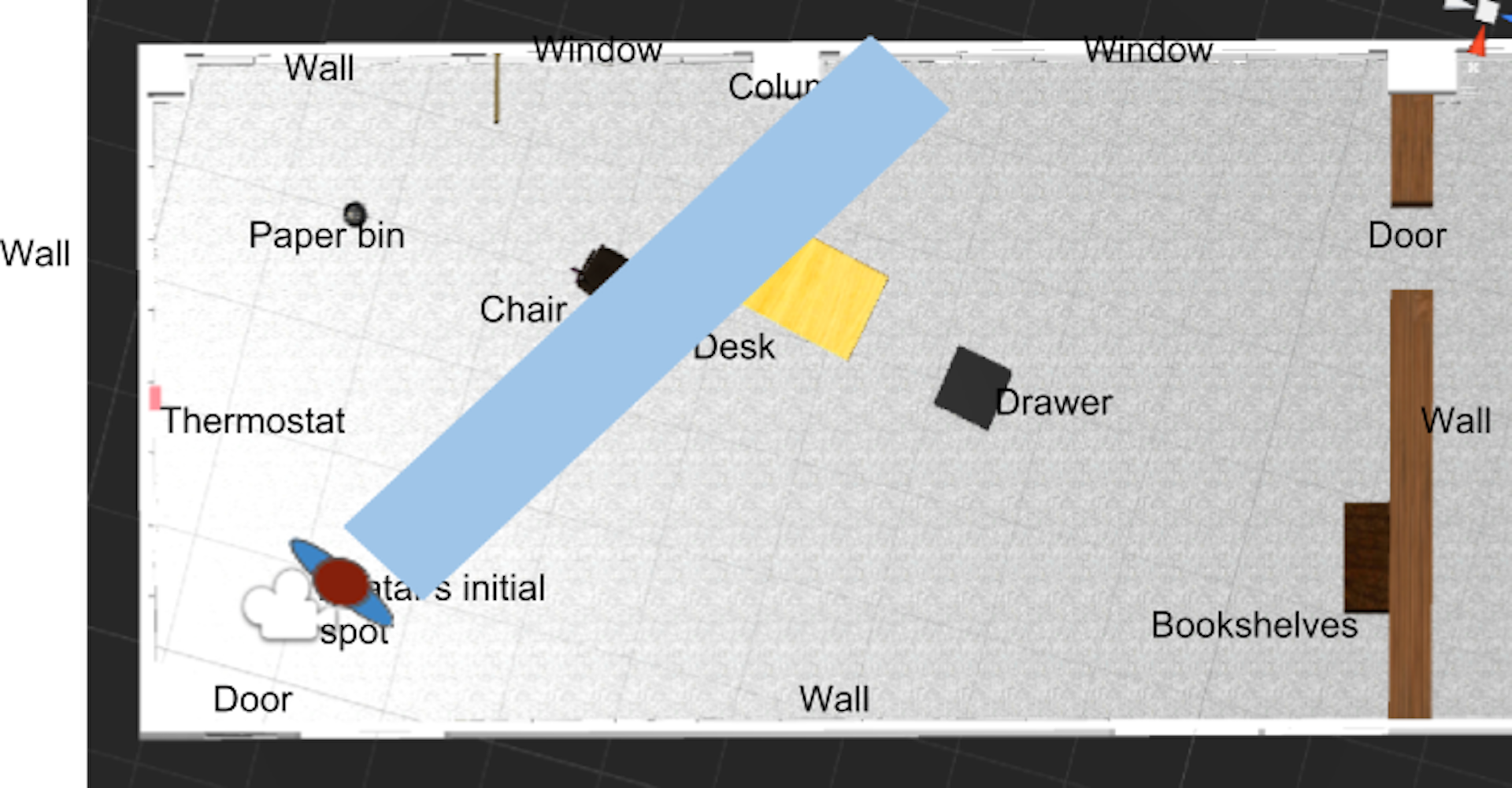

Este sistema permite dirigir la atención a cualquier punto de una sala virtual (interacción cognitiva) e informar de los objetos, personas y otros elementos presentes en cada región del espacio (interacción sensitiva).

Los ciegos llevan su atención, o su mirada, controlando el movimiento de un elemento virtual inédito hasta la fecha: el foco de atención (ver Figura 1). Este solo existe en el mundo virtual. Se controla mediante gestos y va chocando con las representaciones virtuales de los objetos reales a medida que se mueve por la sala virtual.

Otro de los retos a los que se enfrenta la tiflotecnología es cómo informar de los objetos, personas y otros elementos presentes. La principal dificultad estriba en que la vista proporciona información continua, en paralelo y de gran ancho de banda. Pero los canales alternativos, como el oído o el tacto, no tienen las mismas características.

En nuestro modelo de interacción, se informa a los ciegos a través de información multisensorial con una combinación de voz, sonidos, y vibraciones.

Al igual que las soluciones tradicionales, eGLANCE permite familiarizarse con antelación –por ejemplo desde casa– con un lugar desconocido. Posibilita, por un lado, conocer los objetos, personas y otros elementos de una sala sin necesidad de desplazarse. Y por otro, puede guiar a través del mejor camino entre dos puntos, evitando los obstáculos.

Con esta información, las personas invidentes pueden tomar decisiones eficientes en situaciones donde los objetos de su interés están especialmente lejos. Así, disminuye el esfuerzo físico y mental extra al que se ven sometidas en sus decisiones cotidianas.

Además, el uso de nuestro modelo reduce las diferencias con los individuos que pueden ver. A fin de cuentas, proporciona información similar a la que estos últimos obtienen al observar su entorno.

eGLANCE contribuye de esta manera a evitar la discriminación sensorial que sufren los invidentes. Les permite ser mucho más autónomos y, por tanto, manejarse en mayor igualdad con el resto de personas en situaciones corrientes de convivencia en la sociedad.

El modelo de interacción se ha probado experimentalmente con éxito en el propio CTB. Hemos implementado el modelo de tiflointeracción en unas interfaces para móviles y hemos desarrollado, a modo de videojuego, los modelos virtuales de algunas de las salas del centro.

Los investigadores hemos contado con la colaboración de un grupo de voluntarios ciegos compuesto por afiliados a la ONCE, trabajadores de la Fundación ONCE y alumnos adscritos al servicio de apoyo de la UPM.

Los participantes utilizaron los videojuegos para aprender la disposición de cada sala. Posteriormente se midió la calidad de sus mapas cognitivos y su capacidad para desenvolverse en los correspondientes espacios reales.

En la figura 2 se aprecia cómo un voluntario se desplaza por el Smart Home Living Lab del Grupo LST utilizando los elementos que constituyen el prototipo más básico del sistema. Este incluye unos auriculares binaurales, una cámara 3D y un smartphone.

Los resultados que hemos obtenido con este trabajo podría ser una referencia en el desarrollo de interfaces sensibles utilizadas en realidad virtual aumentada para personas ciegas, para proporcionar una mayor eficiencia y eficacia durante el aprendizaje de nuevos entornos.

No obstante, existen algunos retos tecnológicos de carácter más general (no son específicos de la tiflotecnología) que dificultan el escalado de un sistema de estas características para su uso cotidiano. El principal escollo es capturar el dinamismo de los escenarios cotidianos reales. Por un lado, requiere hacer un seguimiento de los cambios de posición de la persona ciega. Por otro, hacer un seguimiento de los elementos móviles presentes en sus alrededores.![]()

José Javier Serrano Olmedo, Profesor Titular de Universidad, Laboratorio de Bioinstrumentación, Universidad Politécnica de Madrid (UPM); Antonio Cobo Sánchez de Rojas, Investigador senior en tiflotecnología y tecnología geriátrica, Universidad Politécnica de Madrid (UPM) y Nancy Enriqueta Guerrón, Profesora, Universidad de las Fuerzas Armadas (Ecuador)

Este artículo fue publicado originalmente en The Conversation. Lea el original.